Автор книги: Мартин Форд

Жанр: Прочая образовательная литература, Наука и Образование

Возрастные ограничения: 16+

сообщить о неприемлемом содержимом

Я верю, что люди, которые за историю своего существования сделали множество открытий и даже научились пользоваться атомной энергией, смогут преодолеть препятствия и создадут интеллект, достаточно сильный для того, чтобы возникла угроза его выхода из-под контроля. Благоразумно начать думать над тем, как убрать эту угрозу еще на стадии проектирования систем ИИ.

М. Ф.: А как это можно сделать?

С. Р.: На мой взгляд, мы не совсем корректно определяем понятие «интеллект». В целом, это рациональное поведение. Если создать машины с аналогичной способностью осуществлять свои намерения, появятся очень умные существа, но со своими целями. И достигать они будут именно их!

Первоначально ИИ был задуман как оптимизатор: то есть искатель оптимальных путей достижения человеческой цели. И это работало, но только потому, что созданные машины не были по-настоящему интеллектуальными и функционировали в ограниченном пространстве. После выхода ИИ в реальный мир все может пойти не по плану. Мы уже видели обвал торговых рынков после появления торговых ботов.

Мне кажется правильным, когда машины, помогающие в достижении наших целей, не знают, в чем эти цели заключаются. Нужна неопределенность относительно характера наших целей. Именно она даст желанную гарантию безопасности.

Попробую продемонстрировать это на примере. Если цель машины приносить кофе, при достаточном интеллекте она сможет понять, что в выключенном состоянии она не сможет этого сделать. Тогда она предпримет шаги для предотвращения выключения. Я считаю, что необходимо заложить в машину цель избегать нежелательных для человека действий. Такое видение ИИ можно описать математически, показав, что гарантия безопасности (то есть в данном случае мотив, под влиянием которого машина позволит себя выключать) напрямую связана с отсутствием информации о целях человека.

Конечно, мое видение ИИ несколько отличается от общепринятого. Но именно так можно построить систему ИИ, более совершенную с точки зрения безопасности и контроля.

М. Ф.: Раз уж речь зашла о безопасности и контроле, поясните, пожалуйста, насколько серьезно следует относиться к гонке вооружений в других странах, особенно в Китае.

С. Р.: Ник Бостром и другие ученые выражали свое беспокойство тем, что, если правительство сочтет стратегическое доминирование в области ИИ важным компонентом национальной безопасности и экономического лидерства, то акцент будет делаться на его максимально быстрое развитие. Забота о степени контролируемости таких систем в этом случае отойдет на второй план.

Эти опасения кажутся мне не лишенными основания. С другой стороны, поскольку мы работаем над системами ИИ, пригодными для использования в реальном мире, у нас есть экономический стимул сделать так, чтобы они оставались под контролем.

Для примера представим продукт, который может появиться в ближайшем будущем: обладающий интеллектом личный помощник, фиксирующий ваши действия, разговоры, отношения и т. п. Фактически это личный секретарь. Вы же понимаете, что систему, которая не разбирается в человеческих предпочтениях и действует небезопасными способами, просто никто не купит. Система, не понимающая нюансов человеческой жизни, может забронировать номер в гостинице за 20 000 долларов в сутки или ответит отказом на предложение встретиться с президентом, потому что на это время вы уже записаны к стоматологу. Кому нужен такой робот? Это станет концом индустрии. Вспомните, что случилось с атомной промышленностью после Чернобыля и Фукусимы. Если мы не сможем решить проблему контроля, область ИИ умрет.

М. Ф.: Но в целом вы оптимист? Думаете, что все получится?

С. Р.: Да, меня можно назвать оптимистом. Мы только начинаем подходить к проблеме управления, но первые попытки кажутся вполне продуктивными. Поэтому я верю, что существует путь развития, который позволит создать доказанно полезные системы ИИ.

Разумеется, есть риск, что даже если мы решим проблему контроля и построим полезные ИИ-системы, кто-то другой может пойти по пути наращивания возможностей ИИ без учета аспектов, связанных с безопасностью. Эдакий доктор Зло, который создаст разрушительную систему ИИ или будет злоупотреблять контролируемым ИИ. В этих сценариях мы постепенно превратимся в ослабленное общество, в котором так много знаний перенесено в машины и так много решений отдано им на откуп, что вернуть контроль над ситуацией мы уже не сможем и потеряем свободу воли.

Такое будущее изображено в фильме «ВАЛЛ-И», где люди отправляются в космос в попытке спастись, а на кораблях их обслуживают машины. Постепенно люди становятся слабее, ленивее и глупее. О риске оказаться в таком будущем тоже следует помнить.

Но я оптимистично надеюсь на будущее, в котором системы ИИ смогут напоминать людям: «Не используйте нас. Получайте знания и навыки самостоятельно. Сохраняйте свои возможности и способности, распространяйте цивилизацию через людей, а не через машины».

9 10

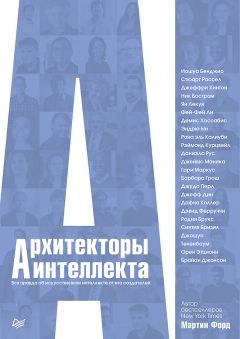

Джеффри Хинтон

“В 1980-х гг., когда вокруг ИИ в целом и метода обратного распространения в частности была большая шумиха, люди ждали чудес и не дождались. Но сегодня чудеса уже происходят, а на шумиху не стоит обращать внимание."

Профессор computer science Университета Торонто, руководитель инженерно-технической службы компании GOOGLE, главный консультант научно-исследовательского центра Vector Institute

Джеффри Хинтона иногда называют крестным отцом глубокого обучения. Именно он стоял у истоков таких ключевых технологий, как метод обратного распространения, машина Больцмана и капсульная нейронная сеть.

Джеффри – член Лондонского королевского общества, а также иностранный член Национальной инженерной академии США и Американской академии искусств и наук. Обладатель премии Румельхарта, награды IJCAI за исследовательские достижения, канадской национальной премии Killam Prize в области разработки, награды имени Фрэнка Розенблатта, золотой медали Джеймса Клерка Максвелла от Института инженеров электротехники и электроники (IEEE), награды C & C от японской корпорации NEC, премии от компании BBVA и высшей награды Канады в области науки и техники – золотой медали Герхарда Херцберга.

Мартин Форд: Широкую известность вам принесла работа над методом обратного распространения ошибки. Расскажите, пожалуйста, что это за метод?

Джеффри Хинтон: Проще всего объяснить от обратного. Считается, что существует четкий алгоритм обучения нейронных сетей. Есть сеть, состоящая из слоев нейронов, снизу – вход в нее, сверху – выход. Все связи между нейронами имеют свой вес. Каждый нейрон смотрит на нейроны нижнего слоя и умножает их активность на вес связей, затем складывает все это и выдает результат. Регулируя вес связей, можно заставить сеть выполнять нужные вам операции, например находить кота на изображении и добавлять соответствующую метку.

Но как с помощью регулировки весов добиться от сети нужного результата? Существует простой и эффективный, но невероятно медленный алгоритм. Всем связям присваиваются случайные веса, сети демонстрируются примеры, и вы смотрите, что получается. Затем один из этих весов немного меняется, и демонстрируется другой набор примеров. Если результат работы сети стал лучше, внесенные изменения сохраняются. В противном случае вес возвращается к исходному значению или меняется в противоположном направлении. Затем эта операция проделывается с весом следующей связи и т. д.

В результате работа сети оценивается для каждого веса, причем на ряде примеров. Каждый вес должен обновляться несколько раз. Это медленно, но результат гарантирован.

Метод обратного распространения ошибки, по сути, позволяет получить такой же результат намного быстрее. Скорость его работы зависит от количества связей. Для сети с миллиардом связей метод обратного распространения сработает в миллиард раз быстрее, чем описанный выше алгоритм.

Прямой алгоритм имитирует процесс эволюции, ведь то, как заложенная в генах информация реализуется в конкретном индивиде, зависит от среды, в которой он находится. По генотипу невозможно точно предсказать, как будет выглядеть фенотип или насколько он будет успешным, потому что на это влияет множество внешних факторов.

Поскольку корректность результатов определяется только весами, которые нам известны, процесс прохождения данных можно контролировать с помощью метода обратного распространения. Его суть состоит в передаче сигналов ошибки от выхода к входу. В процессе их прохождения вычисляется, как следует поменять вес каждой связи, чтобы улучшить выводимый результат.

Вместо того чтобы измерять эффект от внесенных изменений, метод обратного распространения ошибки вычисляет, что получится после внесения изменений, причем для всех весов одновременно. Настройка весов выполняется быстро: сети предоставляется сразу несколько примеров, рассчитывается разность между требуемым выходом и результатами сети, после чего эта информация передается в обратном направлении. Процесс выполняется несколько раз, но все равно работает быстрее эволюционного алгоритма.

М. Ф.: Метод обратного распространения ошибки изобрел Дэвид Румельхарт, а вы развили его?

Дж. Х.: Версии этого метода предлагались еще до Румельхарта. В основном к этой идее приходили независимо друг от друга, поэтому меня всегда смущает, когда в СМИ меня называют автором этого метода. Я главным образом продемонстрировал, как использовать этот метод для изучения распределенных представлений.

В 1981 г. после получения докторской степени я начал работать в городе Сан-Диего, штат Калифорния. Идею метода обратного распространения ошибки предложил Дэвид Румельхарт, а мы с Рональдом Уильямсом помогли в поиске правильных формулировок. Ничего впечатляющего с этим методом мы тогда не сделали. Не было и никаких публикаций. После этого я отправился в Университет Карнеги – Меллона, где работал над машиной Больцмана. Эта идея казалась более интересной, хотя она и не сработала. В 1984 г. я вернулся в Сан-Диего, чтобы сравнить метод обратного распространения с машиной Больцмана. Оказалось, что он дает более убедительные результаты, поэтому я снова начал общаться с Дэвидом Румельхартом.

Но по-настоящему меня восхитила возможность на примере формирования генеалогического древа применить метод обратного распространения к изучению распределенных представлений. На вход подавалось два слова, а возвращалось третье, связанное с обоими. То есть нейросеть как бы улавливала значения слов.

Например, если мать Шарлотты зовут Виктория, то корректным выводом для слов Шарлотта и мать было Виктория. А для слов Шарлотта и отец корректным был ответ Джеймс. Если взять генеалогическое древо, в котором нет разводов, то стандартный ИИ, используя свои знания о семейных отношениях, может сделать вывод, что Виктория – супруга Джеймса. К такому же выводу может прийти нейронная сеть, причем не пользуясь логическими правилами, а просто изучив множество признаков каждого человека. В этом случае Виктория и Шарлотта – это наборы отдельных признаков. Результат взаимодействия двух векторов дает признаки корректного ответа. Потрясает, как сеть изучает векторы признаков и распределенные представления для разных слов.

В 1986 г. мы описали это в статье для журнала Nature. Тема сильно заинтересовала одного из рецензентов. Как психолог, он понимал, что алгоритм, обучающий представлению о вещах, станет огромным прорывом. Так что мой вклад заключается не в открытии алгоритма обратного распространения, а в том, что я смог показать, как этот метод может применяться для обучения распределенным представлениям. Именно это оказалось интересно психологам и, в конечном итоге, людям, которые занимались вопросами ИИ.

В начале 1990-х Иошуа Бенджио перенес этот метод на более быстрые компьютеры. Он применил нейронную сеть к естественному языку. Сеть брала из текста несколько слов в качестве контекста и могла предсказать следующее слово. Ян Лекун, который в это время занимался компьютерным зрением, показал, что метод обратного распространения хорошо обучает фильтры обработки визуального входа. Это не стало особым открытием, так как примерно такие же вещи делает человеческий мозг. А вот то, что метод обратного распространения позволил машине уловить значения слов и синтаксис, стало большим прорывом.

М. Ф.: Правильно ли я понимаю, что в то время работа с нейронными сетями еще не была основным направлением в исследованиях ИИ?

Дж. Х.: До некоторой степени да, но тут нужно отдельно рассматривать ИИ и машинное обучение, с одной стороны, и психологию – с другой. В 1986 г., когда метод обратного распространения стал популярным, им заинтересовались психологи. Это был устойчивый интерес, хотя алгоритм не копировал происходящие в мозге процессы. А в конце 1980-х гг. Ян Лекун получил впечатляющие результаты по распознаванию рукописных цифр. Метод обратного распространения хорошо себя показал и в других областях, таких как контроль мошенничества с кредитными картами. Но ожидания тех, кто считал, что теперь нам будут доступны настоящие чудеса, не оправдались.

В начале 1990-х гг. оказалось, что на небольших наборах данных лучше себя показывают другие методы машинного обучения. Например, метод опорных векторов с меньшими усилиями распознавал рукописные цифры. И интерес к обратному распространению затух.

Идея метода обратного распространения состояла в обучении множества слоев, но обучить удалось только не очень глубокие сети. С точки зрения специалистов по статистике и ИИ мы были мечтателями, которые надеялись получить информацию обо всех весах только по входным и выходным данным. На тот момент нам не хватало знаний, чтобы заставить все это работать.

До 2012 г. большинство специалистов по компьютерному зрению считали все это сумасбродством, хотя системы Яна Лекуна иногда работали лучше, чем их собственные. Ян написал статью, но ее не приняли, так как считалось, что этот способ не даст результатов. Даже в мире науки альтернативные подходы отвергаются.

Но внезапно крупный конкурс выиграли двое моих учеников. Они применили комбинацию методов, разработанных в лаборатории Лекуна, и наших собственных техник и получили в два раза меньше ошибок, чем лучшие системы компьютерного зрения.

М. Ф.: Речь идет о проекте ImageNet?

Дж. Х.: Да. Там случилось то, что периодически происходит в науке. Метод, который привыкли считать полной бессмыслицей, превзошел метод, в который все верили. За следующие два года все переключились на сверточные нейронные сети. Сейчас никто даже не думает о классификации объектов без использования нейронной сети.

М. Ф.: То есть в 2012 г. наступил переломный момент в отношении глубокого обучения?

Дж. Х.: Это был переломный момент для компьютерного зрения. В сфере распознавания речи он случился раньше. В 2009 г. два аспиранта из Торонто показали, что глубокое обучение позволяет улучшить распознавание речи. Они стали стажерами в IBM и Microsoft, а другой мой студент принес эту систему в Google.

М. Ф.: Если почитать современную прессу, создается впечатление, что нейронные сети и глубокое обучение – это эквивалент ИИ.

Дж. Х.: Долгое время ИИ считался системой, запрограммированной на определенные правила обработки символьных строк. В этом заключался интеллект. Оставалось уточнить, как выглядят эти правила и строки. Затем появились нейронные сети. Это была попытка смоделировать разум по образцу человеческого мозга.

Обратите внимание, что ИИ в том виде, как его изначально понимали, не имел отношения к обучению. В 1970-х гг. упор делался на определение правил и выбор символических выражений. Считалось, что рано думать об обучении. Тех же, кто занимался нейронными сетями, интересовали вопросы обучения, восприятия и управления движением. Они считали, что с точки зрения эволюции способность рассуждать логически появляется на поздних стадиях развития.

Сейчас в промышленности и правительстве термин «ИИ» используют для обозначения глубокого обучения, что приводит к парадоксальным ситуациям. Например, в Торонто было щедро профинансировано создание научно-исследовательского центра Vector Institute, который занимается фундаментальными исследованиями в области глубокого обучения. Разумеется, на финансирование претендуют многие, и один университет заявил, что у них больше специалистов по ИИ, чем в Торонто, приведя в качестве доказательства количество ссылок на их работы. При этом они занимаются классическим ИИ. Мне кажется, что лучше вообще не пользоваться этим термином, чтобы не давать поводов для подобной путаницы.

М. Ф.: Вы считаете, что термин «искусственный интеллект» должен быть связан только с нейронными сетями?

Дж. Х.: Я думаю, общая идея ИИ состоит в создании небиологических интеллектуальных систем. Хотя до сих пор у многих, особенно у старшего поколения ученых, сохраняется наивное представление об ИИ как о системе, умеющей манипулировать символическими выражениями. Но даже наборы символов на входе и выходе не означают, что внутри мы имеем дело с символьными строками. Там находятся векторы нейронной активности.

М. Ф.: В конце 2017 г. вы сказали в интервью[11]11

https://www.axios.com/artificial-intelligence-pioneer-says-we-need-to-start-over-1513305524-f619efbd-9db0-4947-a9b2-7a4c310a28fe.html

[Закрыть], что алгоритм обратного распространения ошибки нужно отбросить, все начать с нуля. Что вы имели в виду?

Дж. Х.: В данном случае неверно передан контекст беседы. Я поднимал вопрос о том, насколько метод обратного распространения может помочь в понимании принципов работы мозга. Есть основания полагать, что в мозге ничего подобного не происходит. Но это не означает, что метод не нужно применять при моделировании искусственных систем.

М. Ф.: И возможно, результаты будут улучшаться?

Дж. Х.: Мы работаем над совершенствованием глубокого обучения. Я допускаю появление других алгоритмов, действующих альтернативными способами. Но даже их появление не значит, что следует отказаться от метода обратного распространения.

М. Ф.: А почему вас заинтересовали ИИ и нейронные сети?

Дж. Х.: Мой школьный друг Инман Харви был очень хорошим математиком. И однажды заинтересовался идеей, что мозг может работать как голограмма.

М. Ф.: Голограмма как трехмерное представление?

Дж. Х.: Вы помните, что если разрезать голограмму, получится не две половины изображения, а нечеткое изображение всей сцены в каждой половине? Такой способ распределения информации отличается от того, к чему мы привыкли. Отрезав кусок фотографии, вы просто потеряете информацию о том, что было на этом фрагменте.

Инмана заинтересовал тот факт, что таким же способом может работать память человека, в то время как каждый отдельный нейрон не отвечает за ее сохранение. Он предположил, что информация в мозге хранится благодаря настройке силы связей между нейронами, и что, по сути, это распределенное представление, то есть попытка изобразить какие-то вещи, которым соответствует активность в ряде нейронов, но каждый нейрон участвует в представлении разных вещей. При таком подходе исключено однозначное соответствие между нейронами и понятиями. Это первое, что меня заинтересовало. Кроме того, было интересно, каким образом мозг может учиться чему-то, регулируя силу соединений между нейронами.

М. Ф.: И это в старших классах школы? Потрясающе! А как поменялись ваши интересы после поступления в университет?

Дж. Х.: Там я начал изучать физиологию. И узнал, как нейроны распространяют потенциалы действия. Помогли эксперименты на аксоне гигантского кальмара. Оказалось, что именно так работает мозг. Но я разочаровался, узнав, что не существует модели процесса представления или изучения различных вещей.

Я переключился на психологию, думая, что здесь мне скажут, как работает мозг. Но в то время в Кембридже основной упор делался на бихевиоризм, и изучение психологии сводилось к крысам в лабиринтах. Конечно, занимались и когнитивной психологией, но это не имело отношения к вычислительным методам, поэтому мне казалось, что мы никогда не узнаем, как же работает мозг.

В рамках проекта по изучению развития детей я смотрел, как в возрасте от 2 до 5 лет меняется восприятие различных свойств. Оказалось, что совсем маленькие дети в основном интересуются цветом и текстурой, а по мере взросления их начинает интересовать форма. Детям демонстрировались три объекта, один из которых отличался от двух других. Например, два желтых круга и один красный. Мне нужно было научить детей убирать лишний объект.

В следующих заданиях лишним был объект другой формы. После этого детям предложили желтый треугольник, желтый круг и красный круг. Предполагалось, что если детей больше интересует цвет, они уберут красный круг, а если форма – лишним окажется желтый треугольник. Один пятилетний ребенок указал на красный круг и сказал: «Он покрашен в неправильный цвет».

Я работал над подтверждением крайне примитивной модели, которая всего лишь утверждала, что фокус смещается от цвета к форме, но никак не объясняла почему. Ребенок же обработал информацию, которую ему давали в виде обучающих примеров, и, столкнувшись с набором, допускавшим удаление более чем одного объекта, решил, что, возможно, что-то покрашено не в тот цвет.

Тестируемая модель не была адаптирована к уровню сложности изучаемой системы, и других адекватных моделей не было. Передо мной была интеллектуальная система, умеющая обрабатывать информацию и делать выводы о причинах происходящего. И я прекратил ее исследовать таким неэффективным способом.

М. Ф.: После этого вы начали заниматься ИИ?

Дж. Х.: Нет, я стал плотником. И некоторое время наслаждался этим, пока не увидел работу настоящего мастера. Это меня так расстроило, что я решил вернуться в науку.

М. Ф.: Если вспомнить, что было дальше, наверное, к лучшему, что вам не удалось стать по-настоящему квалифицированным плотником!

Дж. Х.: Дальше я принял участие в проекте по изучению развития речевых навыков у детей. Хотелось понять, каким образом на них влияет принадлежность к определенному социальному классу. Мне нужно было создать вопросник для оценки отношения матерей. Первое же интервью меня ошарашило. Женщина из бедного пригорода Бристоля на вопрос, как она относится к тому, что ребенок разговаривает, ответила: «Если он начинает разговаривать, мы его бьем». На этом моя карьера социального психолога завершилась.

Я поступил в аспирантуру Университета Эдинбурга по специальности ИИ. Моим руководителем был Хью Кристофер Лонге-Хиггинс, который изначально занимался химией в Кембридже, а затем переключился на изучение ИИ. Он верил в компьютерное моделирование, поэтому я попросился к нему. К сожалению, у него как раз начался переломный период. Он решил, что нейронные модели ничего не дают, а к пониманию интеллекта нужно идти через язык.

Напомню, что как раз тогда появились модели систем, которые могли определять расположение блоков. В них применялась обработка символов. Американский профессор Терри Виноград показал, как заставить компьютер в определенной степени понимать язык, отвечать на вопросы и фактически следовать командам. Можно было сказать: «Покажи блок, который находится в синем ящике на вершине красного куба», и получить желаемое. Лонге-Хиггинса это сильно впечатлило, и он решил над этим работать, я же предпочел продолжить изучение нейронных сетей.

Я считаю Кристофера замечательным ученым, хотя мы и не смогли прийти к согласию в работе. Он поддерживал меня, даже когда я отказывался делать то, что он говорил. В конце концов, я защитил диссертацию по нейронным сетям, хотя в то время они, по общему мнению, были полной чепухой.

М. Ф.: Примерно в то время Марвин Минский и Сеймур Пейперт написали свою книгу «Персептроны»[12]12

Минский М., Пейперт С. Персептроны / Пер. с англ. Г. Гимельфарба и В. Шарыпанова. – М.: Мир, 1971. – 261 с.: ил.

[Закрыть].

Дж. Х.: Нет, защитился я в начале 1970-х гг., а книга Минского и Пейперта вышла в конце 1960-х гг. Практически все, кто занимался ИИ, думали, что нейронным сетям конец. Считалось, что интеллект обусловлен программно, и нужно просто понять, какие программы использует мозг.

Что интересно, были и сторонники логического подхода, которые верили в парадигму нейронных сетей. Например, Джон фон Нейман и Алан Тьюринг полагали, что большие сети нейронов способны помочь в изучении интеллекта. Но доминировал подход, в котором одни строки символов формировали другие. Казалось, что модель логических рассуждений должна выглядеть именно так. Мало кто верил, что можно понять интеллект, глядя на то, как реализован мозг. Было убеждение, что интеллект должен рассматриваться сам по себе.

М. Ф.: В прессе много писали, что успехи глубокого обучения преувеличены и следует сокращать инвестиции в эту сферу. Мне даже встречалось выражение «зима ИИ». Исследования зашли в тупик?

Дж. Х.: В 1980-х гг., когда вокруг ИИ в целом и метода обратного распространения в частности была большая шумиха, люди ждали чудес и не дождались. Но сегодня чудеса уже происходят, а на шумиху не стоит обращать внимание. Наши мобильные телефоны распознают речь, компьютеры узнают объекты на фотографиях, Google выполняет машинный перевод. Искусственно созданный ажиотаж означает раздачу обещаний, которые никто не собирается выполнять. Но сейчас мы уже многого достигли и не собираемся на этом останавливаться.

В интернете я иногда вижу рекламу, где говорится, что это индустрия стоимостью 19,9 триллиона долларов. Кажется, что это много и похоже на обман, но идея о том, что это сфера с многомиллиардными доходами, явно не просто шумиха, потому что несколько человек вложили в нее миллиарды долларов, и это сработало для них.

М. Ф.: Во что лучше всего инвестировать для продвижения вперед? Ведь все еще остались люди, которые верят в условный ИИ и считают, что оптимально совмещать глубокое обучение с более традиционными подходами. Как вы относитесь к этой точке зрения?

Дж. Х.: Я считаю, что работа мозга – это взаимодействие больших векторов нейронной активности. И именно по такому принципу будет работать ИИ. Разумеется, понять механику рассуждений тоже важно, но, мне кажется, мы сможем это сделать уже после того, как реализуем все остальное.

Я не верю в гибридные системы. Был пример в автомобильной промышленности, когда электродвигатель стали использовать для впрыскивания бензина. Точно так же сторонники условного ИИ, признавая все преимущества глубокого обучения, хотят использовать его как слугу, который обеспечит функционирование символических рассуждений. Это попытка остаться на старых позициях, невзирая на меняющиеся обстоятельства.

М. Ф.: Мне вспоминается ваш последний проект, связанный с так называемыми капсулами, имитирующими, как я понимаю, колонки кортекса в мозгу. Считаете ли вы, что результаты изучения мозга следует включать в работу с нейронными сетями?

Дж. Х.: Капсулы появились как сложная и умозрительная комбинация полудюжины разных идей. Об успехах этой концепции пока говорить рано, но ее основой действительно послужила структура человеческого мозга. Думать о работе с нейронными сетями на базе достижений нейробиологии несколько наивно. Ученые пытаются понять базовые принципы функционирования мозга, но при этом есть еще и многочисленные детали, которые по-разному выглядят на разном аппаратном обеспечении. Графические процессоры (GPU) мало напоминают мозг, но это не мешает нам искать общие принципы работы мозга и нейросетей. Например, в обоих случаях большая часть знаний возникает благодаря обучению, а не механическому запоминанию фактов.

Для условного ИИ нужна огромная база фактов и правила их связи друг с другом. Перенести какое-то знание из одного мозга в другой невозможно. В голове множество параметров, то есть весов связей между отдельными нейронами, которые не передадутся. Если один человек расскажет, каким образом что-то работает, другой может повторить эти действия, но не более. И это хорошо, потому что у каждого своя нейронная сеть.

М. Ф.: Правда ли, что глубокое обучение в основном происходит на базе маркированных данных, то есть речь идет о так называемом обучении с учителем, а задача обучения без учителя еще не решена?

Дж. Х.: Это не совсем так. Существует большая зависимость от размеченных данных, но вопрос в том, что считать такими данными. Например, если я попрошу вас предсказать следующее слово в большой текстовой строке, меткой правильного ответа будет слово, которое фактически там фигурирует. Дополнительные метки тут не нужны. А если нужно обучиться распознавать на картинках кошек, потребуется метка «кошка», которая не является частью изображения. Эти метки нужно будет добавлять вручную. По идее первая задача тоже относится к обучению с учителем, потому что мы имеем дело с метками. Но это своего рода промежуточный вариант между маркированными и немаркированными данными.

М. Ф.: Дети по большей части учатся без учителя.

Дж. Х.: Исходя из того, что я говорил выше, ребенок воспринимает окружающую среду, пытаясь предсказать, что будет дальше. Затем, когда что-то происходит, событие помечается как правильно или неправильно угаданное. К сожалению, в случае прогнозирования сложно понять, какой из вариантов, «с учителем» или «без учителя», применяется. Задача, в которой по набору изображений нужно предсказать, какое будет следующим, не попадает ни в одну из двух категорий.

М. Ф.: То есть одно из основных препятствий сейчас – отсутствие общей формы обучения?

Дж. Х.: Да. Но я утверждаю, что решить задачу предсказания могут алгоритмы обучения с учителем.

М. Ф.: А как бы вы определили сильный ИИ?

Дж. Х.: Меня вполне устраивает официальное определение, утверждающее, что это интеллект, сравнимый с человеческим, но многие думают, что появятся отдельные модули ИИ, которые будут становиться все умнее и умнее. Они не понимают, что нейронные сети в чем-то превосходят людей, а в чем-то сильно уступают им. Например, ИИ-система может лучше интерпретировать медицинские изображения, но ей сложно рассуждать о них.

Представляя отдельные ИИ-системы, люди игнорируют социальный аспект. Для ИИ требуются вычислительные ресурсы, поэтому создание сильного ИИ приведет к появлению сообществ интеллектуальных систем. Ведь сообществу доступно гораздо больше данных, чем отдельной системе. Лучше распределить данные по множеству систем и заставить их общаться друг с другом.

М. Ф.: И все сведется к появлению связанного интеллекта?

Дж. Х.: Но ведь в мире людей все обстоит точно так же. Мы извлекаем знания из источников, составленных для нас другими людьми. А опыт обучения позволяет прийти к аналогичному пониманию.

М. Ф.: Реально ли создать сильный ИИ?

Дж. Х.: В компании OpenAI уже есть система, играющая в сложные компьютерные игры как одна команда.

М. Ф.: А когда, по вашим прогнозам, ИИ научится рассуждать, думать и действовать как человек?