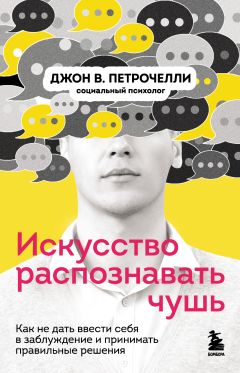

Текст книги "Искусство распознавать чушь. Как не дать ввести себя в заблуждение и принимать правильные решения"

Автор книги: Джон Петрочелли

Жанр: Зарубежная психология, Зарубежная литература

Возрастные ограничения: +16

сообщить о неприемлемом содержимом

Текущая страница: 5 (всего у книги 15 страниц) [доступный отрывок для чтения: 5 страниц]

Когда Лангер и ее коллеги обращались с просьбой без причины, люди в очереди уступали им место в 60 % случаев. При этом, когда экспериментаторы обращались с просьбой, подкрепляя причиной, не важно настоящей или придуманной, уступчивость выросла до 94 % и 93 % соответственно! Такие показатели становились менее вероятными, когда уступка оказывалась масштабнее (например, просьба пропустить снять копию с 20 страницами вела к уступчивости в диапазоне 24–42 %). И тем не менее уровень 93 % для выдуманной причины – невероятный результат.

Такое же абсурдное открытие сделал социальный психолог Роберт Чалдини. Он дал участникам определенное количество времени для сбора как можно большего количества денег с незнакомых людей на улицах большого города, при этом не устраивая представления[88]88

Чалдини, Р. Б. Психология влияния. – Питер, 2012.

[Закрыть]. Подавляющая часть успешно выполнивших задание знали волшебное «потому что». Удивительно, но следовавшие за этим слова не играли никакой роли. Единственное, что было важным, насколько часто звучало «потому что».

Иногда контекст влияет на чушеверность, поскольку в области суждений нет объективно установленного стандарта. Воспринимать что-либо точно и четко очень сложно, потому что у нас нет очевидной точки отсчета для восприятия. Владельцы ресторанов и шеф-повара отлично знают этот трюк. В меню можно увидеть чилийского морского окуня, однако точное название рыбы – патагонский клыкач. На самом деле чилийский морской окунь даже не окунь, это треска, но «чилийский морской окунь» звучит намного аппетитнее, чем «морская треска» или «патагонский клыкач». В области искусства, еды или недвижимости, где есть место субъективности и нестабильности, относительно легко убедить людей в собственной компетенции. С другой стороны, вероятно, мне будет сложно убедить вас, что я – спринтер мирового класса, способный побить мировой рекорд Усейна Болта, ведь вам достаточно просто засечь, за сколько я пробегу стометровку, и мой результат (14 секунд) будет на пять секунд медленнее. основополагающий компонент – это уровень уверенности. Убеждение и влияние часто работают лучше всего в условиях неопределенности, поскольку неуверенные люди не ищут четких ответов и, честно говоря, часто знают недостаточно, чтобы определить чушь.

Когнитивная чушеверность: Как мы думаем

Как способы мыслить влияют на нашу чушеверность? Возможно, одна из ключевых ошибок критического мышления, делающая нас чушеверными, это путаница между аргументами и доказательствами. Аргумент – это обоснование, или теория, подкрепляющая утверждения. Он помогает понять, как или почему что-либо происходит, но не показывает и не подтверждает, что это происходит по конкретным причинам. Доказательства, в свою очередь, – доступная информация или факты, показывающие, что убеждение или утверждение является истинным. В случае с ними необходимы проверка и подтверждение. Доказательства требуют систематических наблюдений, проводимых при наличии очевидно и объективно измеримых параметров. Помимо этого, требуют определения демонстрируемых критериев. Если я утверждаю, что самолеты летают, я должен четко определить, что имею в виду под полетом. Как высоко над землей он должен находиться, чтобы можно было сказать, что он летит? И как долго? В максимально приближенных к идеалу условиях мы можем провести диагностические тесты, чтобы определить, летают ли самолеты.

Меня успокаивает мысль, что самолет полетит и безопасно доставит меня туда, куда нужно. Основаны ли мысли на аргументах или на подлинных доказательствах? Я могу сказать, что на самолете можно добраться из Нью-Йорка до Лондона, потому что это – задача самолетов. Или могу пойти дальше, рассказав о крыльях, двигателе, топливе и пилоте, перейти к более тонким деталям физики полета. Однако моя аргументация не служит доказательством. Всех аргументов о возможности полета было недостаточно, чтобы убедить первых пассажиров рискнуть жизнью, забравшись в конструкцию, насчет которой первые авиаконструкторы-экспериментаторы были убеждены: она может лететь, и полетит. Только после того, как братья Райт разобрались в механике полета и представили людям видимые доказательства, что самолеты способны летать, люди поверили в самолетостроение.

Несмотря на то что доказательства можно интерпретировать разными способами, они всегда лучше и убедительнее голых аргументов.

Подкрепленные фактическими данными, доказательства уменьшают возможность положиться на выдуманные аргументы. И когда речь заходит о серьезных вещах, например о том, чтобы доверить свою жизнь пилотам, я уверен: они довезут меня из одной точки в другую, поскольку есть надежные доказательства, что самолеты летают, а не теоретические аргументы или предсказания, что они могут это делать.

Деанна Кун, когнитивный психолог, провела важное исследование, посвященное тому, как люди генерируют аргументы, в котором протестировала, различают ли люди аргументы и доказательства[89]89

Kuhn, D. The skills of argument. Cambridge: Cambridge University Press, 1991.

[Закрыть]. В данном исследовании участники сначала выписывали собственные убеждения по поводу случайных тем, например почему преступники, вышедшие из тюрьмы, часто возвращаются к преступной жизни. Затем Кун просила привести доказательства их взглядам. Большинство ответов сложно было отнести к категории аргументов. На самом деле только 16 % участников эксперимента представили подлинные доказательства, а бо́льшая их часть были тем, что Кун назвала псевдодоказательствами (например, сценарий, который изображает, как все могло выглядеть или как описанный процесс мог произойти).

Результаты, полученные Кун, показали: люди могут верить в нечто, сами не понимая почему или не имея никаких доказательств тому, что их убеждения истинны. Подобное отсутствие понимания вносит свой вклад в тенденцию восприятия аргументов в качестве доказательств. Это проблема, так как сама суть чушеверности – склонность поддаваться влиянию аргументов, не подкрепленных доказательствами или заботой об истине. Не понимая и не воспринимая разницу между данными понятиями, человек более подвержен влиянию чуши.

Есть и хорошие новости: от склонности воспринимать аргументы в качестве доказательств можно избавиться. На самом деле все достаточно просто. Надо лишь задавать вопрос не «почему?», а «как?». Когда людей просят объяснить, почему они считают нечто правдой или почему думают, будто это нечто работает, они склонны обращаться к простым подкреплениям, а именно к своему мнению и теоретическим аргументам. Однако, когда людям задают вопрос, каким образом они пришли к выводу, что нечто является правдой, или как работает это нечто, они обращаются к более трудоемким подкреплениям – ищут доказательства. Несмотря на то что склонность к аргументам кажется сильнее склонности к доказательствам (аргументы искать проще), можно практиковаться, задавая себе вопросы «как?». Например: «Как я понял, что это правда?» – подобным образом мы делаем важный шаг к уменьшению чушеверности.

Когнитивное исследование, проведенное психологом Амноном Гласснером и его коллегами, подтвердило это[90]90

Glassner, A., Weinstock, M., Neuman, Y. «Pupils’ evaluation and generation of evidence and explanation in argumentation». British Journal of Educational Psychology, 75, 105–118, 2005.

[Закрыть]. Они просили участников подумать о спорных вопросах, которые часто обсуждают, например ведет ли использование телефона за рулем к аварии. Затем половину участников спрашивали: «Как вы поняли, что использование телефона за рулем ведет к авариям?» – в то время как второй группе задавали другой вопрос: «Почему вы думаете, что использование мобильного телефона за рулем ведет к авариям?» Первая группа была склонна приводить доказательства. С другой стороны, те, кто отвечал на вопрос «почему?», значительно чаще приводила аргументы. Такая простая манипуляция привела к огромным различиям в результатах, поскольку выбор между аргументом и доказательством обусловлен целью рассуждения, которую в свою очередь обусловила постановка вопроса.

С точки зрения когнитивности в чушеверность вносит свой вклад любой фактор, который делает утверждение проще для понимания, представления или запоминания. Чем проще представить или понять нечто, тем более мы склонны убедить себя в «правдивости». Данная когнитивная ошибка часто используется маркетологами, политиками и другими «профессиональными» мастерами убеждения, так как она сильно влияет на суждения и восприятие правды[91]91

Borgida, E., Nisbett, R. E. «The differential impact of abstract vs. concrete information on decisions». Journal of Applied Social Psychology, 7, 258–271, 1977;

Reyes, R. M., Thompson, W. C., Bower, G. H. «Judgmental biases resulting from differing availabilities of arguments». Journal of Personality and Social Psychology, 39, 2–12, 1980.

[Закрыть]. Когда-то давно выходила известная телевизионная реклама Tootsie Pop[92]92

Леденцы на палочке, подобные чупа-чупсу (прим. пер.).

[Закрыть], в которой задавался вопрос: «Сколько раз надо лизнуть леденец, чтобы добраться до серединки?» Так запомнившаяся первая версия рекламы вышла в 1968 году, и с тех пор каждый день производится и продается 20 млн конфет, которые в лучшем случае просто неплохие на вкус[93]93

Tootsie Roll Inc. https://tootsie.com/faqs; Aaseng, N. Business builders in sweets & treats. Oliver Press, 2005.

[Закрыть].

Вне зависимости от того, насколько легко представить, понять или запомнить информацию, мы не можем определить ее качество только по этим признакам. Хотя мы с легкостью способны представить, как Элвис Пресли сфабриковал собственную смерть и как он бродит по Грейсленду до сих пор, данная легкость не приравнивается к правде. Ошеломительный пример самообмана продемонстрировало исследование Ларри Джакоби и его коллег. Они просили участников зачитать список имен, в котором были известные люди и неизвестные[94]94

Jacoby, L. L., Kelley, C., Brown, J., Jasechko, J. «Becoming famous overnight: Limits on the ability to avoid unconscious influences of the past». Journal of Personality and Social Psychology, 56, 326–338, 1989;

Jacoby, L. L., Woloshyn, V., Kelley, C. «Becoming famous without being recognized: Unconscious influences of memory produced by dividing attention». Journal of Experimental Psychology: General, 118, 115–125, 1989.

[Закрыть]. В то время как участники читали список, экспериментаторы отвлекали их, называя вслух ряд случайных чисел. На следующий день участнику выдавали новый список, и надо было определить, известны эти люди или нет. Некоторые имена взяли из старого списка и добавили новые. Вопрос заключался в следующем: станут ли неизвестные в представлении участников известными всего лишь за одну ночь?

И ответ на этот вопрос – да! Респонденты были склонны называть неизвестных людей известными, если накануне читали их имя в списке. Так они путали субъективное ощущение знакомо звучащего имени неизвестного человека с его известностью. Данное открытие предполагает, что простое ознакомление с ложными утверждениями может спустя какое-то время заставить нас воспринимать их как истинные.

Характерные особенности мышления могут влиять и на то, насколько мы чушеверны. Выделяют два ключевых способа мышления: интуитивное и рефлексивное. Чтобы понять разницу, попробуйте решить следующую задачу:

Бейсбольная бита и мяч стоят 1 доллар и 10 центов. Бита стоит на 1 доллар дороже мяча. Сколько стоит мяч?

Если вы похожи на большинство людей, то первым ответом было 10 центов. Но несмотря на то что это самый распространенный ответ, он неправильный. Если мяч стоит 10 центов, то бита должна стоить 1 доллар, и тогда бита будет стоить только на 90 центов дороже мяча. Бита стоит на 1 доллар дороже, и единственный вариант, когда это утверждение становится истинным, – если бита стоит 1 доллар и 5 центов, а мяч – 5 центов. Эту задачку делает сложной склонность к интуитивному и неправильному ответу, которая намного сильнее, так как данный ответ приходит нам в голову намного быстрее. Чтобы сделать правильный вывод, надо побороть это стремление, остановиться и задуматься на некоторое время – и для этого нужно рефлексивное мышление.

Вопрос про биту и мяч взят из теста когнитивной рефлексии (CRT, Cognitive Reflection Test), оценивающего предрасположенность к интуитивному и рефлективному мышлению. Интуитивное мышление – относительно не требующая усилий форма мышления, которая опирается на инстинкты и приводит к выводам достаточно быстро с помощью автоматических реакций. Люди, мыслящие интуитивно, склонны полагаться на чутье. Рефлексивное, – практически полная противоположность. Оно требует сознательных аналитических усилий, размышлений и системного применения логики. Люди, склонные к рефлексивному мышлению, часто подвергают сомнению инстинкты и думают о других вариантах.

Эксперты никоим образом не ограждены от интуитивного мышления, они точно так же поддаются ему, как и остальные[95]95

Frederick, S. «Cognitive reflection and decision making». Journal of Economic Perspectives, 19, 25–42, 2005.

[Закрыть]. Но являются ли люди, склонные к интуитивному мышлению, более чушеверными? Исследование, проведенное профессором психологии Гордоном Пенникуком из Университета Реджайны, дает ответ на этот вопрос. В рамках эксперимента участники проходили тест когнитивной рефлексии. Помимо этого они отвечали, насколько убеждены в истинности случайных цитат Дипака Чопры из Twitter (например, «механика манифестации, намерения и бесстрастности сконцентрирована в сущности, позволяющей разворачиваться противостоянию возможностей») или бессмысленной чуши (например, «скрытое значение формирует бесподобную абстрактную красоту»). Пенникук обнаружил: люди, мыслящие интуитивно, в большей степени склонны воспринимать чушь Чопры наполненной мудростью, в отличие от рефлексивных мыслителей[96]96

Bronstein, M. V., Pennycook, G., Bear, A., Rand, D. G., Cannon, T. D. «Belief in fake news is associated with delusionality, dogmatism, religious fundamentalism, and reduced analytic thinking». Journal of Applied Research in Memory and Cognition, 8, 108–117, 2019;

Pennycook, G., Cannon, T. D., Rand, D. G. «Prior exposure increases perceived accuracy of fake news». Journal of Experimental Psychology: General, 147, 1865–1880, 2018;

Pennycook, G., Rand, D. G. «Who falls for fake news? The roles of bullshit receptivity, overclaiming, familiarity, and analytic thinking». Journal of Personality, 88, 185–200, 2020.

[Закрыть]. Другими словами, подверженность влиянию ерунды соотносится с интуитивным, менее затратным и более беспечным способом мышления.

Учитывая исследование Пенникука, неудивительно, что люди, набравшие высокие баллы в тестировании когнитивной рефлексии, с большей точностью отделяют фейковые новости от настоящих, даже если заголовки совпадают с их политическими взглядами[97]97

Pennycook, G., Rand, D. G. «Lazy, not biased: Susceptibility to partisan fake news is better explained by lack of reasoning than by motivated reasoning». Cognition, 188, 39–50, 2019.

[Закрыть]. Пенникук предполагает, что люди верят в фейковые новости и другие формы чуши не из-за какой-то мотивации мышления (например, желания, чтобы ложные утверждения оказались правдой), а из-за того, что склонны к ленивому мышлению и не обдумывают то, что видят в соцсетях.

Так как интуитивный и рефлексивный способы мышления в целом не зависят от интеллекта, высокий показатель IQ не гарантирует, что человек будет меньше подвержен чуши. Даже психологи, которые предсказывали результаты исследований послушания, проведенных Милгрэмом, риелторы, оценивающие недвижимость, или врачи, ставящие диагноз, могут быть подвержены чуши, когда судят о чем-то в своей области как новички[98]98

Gigerenzer, G., Hertwig, R., Pachur, T. Heuristics: The foundations of adaptive behavior. Oxford University Press, 2011;

Gigerenzer, G., Todd, P. M. Simple heuristics that make us smart. Oxford University Press, 1999;

Принятие решений в неопределенности. Правила и предубеждения / под ред. Д. Канеман, А. Тверски, П. Славик. – Гуманитарный центр, 2021.

[Закрыть]. Не надо далеко ходить за примером: схема Понци, провернутая Мейдоффом, отлично показала, как умные люди могут быть наивными инвесторами, не обратившими внимания на риски и тревожные сигналы.

В когнитивистской литературе пишут как минимум о двух причинах подобного поведения: (1) даже очень умные не задаются базовыми вопросами, лежащими в основе критического мышления, столкнувшись с чушью, и (2) очень умные люди не являются более устойчивыми к хроническим ошибкам мышления[99]99

Shermer, M. Why people believe weird things: Pseudoscience, superstition, and other confusions of our time. W. H. Freeman and Company, 1997.

[Закрыть].

Многие хронические ошибки мышления функционируют как когнитивные искажения.

Вне зависимости от того, что лежит в их основе: отсутствие мотивации или ментальных ресурсов, необходимых для критического восприятия заявлений, – они повышают чушеверность[100]100

Канеман, Д. Думай медленно… решай быстро. – АСТ, 2014.

[Закрыть]. К сожалению, список хронических искажений мышления, которые провоцируют когнитивную чушеверность, очень длинный[101]101

Allen, S. Dumbth and 81 ways to make Americans smarter. Prometheus Books, 1989;

Бек, Д. Когнитивная терапия. Полное руководство. – Вильямс, 2018.

Morrow, D. R. Giving reasons: An extremely short introduction to critical thinking. Hackett Publishing Company, 2017; Shermer, M. Why people believe weird things: Pseudoscience, superstition, and other confusions of our time. W. H. Freeman and Company, 1997.

[Закрыть]. Более того, ситуация усугубляется тем, что они кажутся вполне логичными. Например, если спросить: «Сколько животных каждого вида Моисей взял в Ковчег?» – большинство людей ответят: по два, а не ноль (хотя ноль – правильный ответ)[102]102

Erickson, T. D., Mattson, M. E. «From words to meaning: A semantic illusion». Journal of Verbal Learning and Verbal Behavior, 20, 540–551, 1981;

Song, H., Schwarz, N. «Fluency and the detection of misleading questions: Low processing fluency attenuates the Moses illusion». Social Cognition, 26, 791–799, 2008.

[Закрыть], несмотря на то что они прекрасно знают: библейский персонаж, построивший Ковчег, – это Ной.

У меня есть любимчик, если говорить об ошибках мышления (см. более полный их список в «Приложении», с. 247–255), – самая убедительная и незаметная ошибка. Она называется «эффект фрейминга». Это когнитивное искажение, при котором на наши решения влияет обрамление информации, позитивное или негативное. Обрамление вариантов решения может влиять на наши предпочтения, допустим, на убеждение, что большее количество чего-то – лучше. Отличный пример эффекта фрейминга можно найти в рекламе. Люди скорее предпочтут воду, чистую на 99 %, чем нечистую на 1 %, несмотря на то что это одно и то же. Диетическое на 85 % мясо лучше жирного на 15 %, хотя и это одно и то же[103]103

Seta, J. J., Seta, C. E., McCormick, M. «Commonalities and differences among frames: A unification model». Journal of Behavioral Decision Making, 30, 1113–1130, 2017.

[Закрыть].

Обрамление информации способно повлиять и на то, как мы оцениваем риски[104]104

Tversky, A., Kahneman, D. «The framing of decisions and the psychology of choice». Science, 211, 453–458, 1981.

[Закрыть]. Представьте, что вы – главврач большой больницы, где невероятно быстро распространяется редкая болезнь. Вероятно, она убьет 600 пациентов. Были предложены два лекарства, но вы можете выбрать только одно. Если выберете лекарство А, 200 пациентов спасутся. Если предпочтете лекарство Б, есть один из трех шансов, что спасутся все, но два из трех, что все погибнут. Какой препарат выберете?

Вероятно, вы сейчас склоняетесь в сторону лекарства А. Бо́льшая часть людей не хотят рисковать жизнями 600 людей, используя вариант Б, раз они уверены, что будут спасены 200 жизней.

Теперь подумайте о похожем сценарии, но с лекарствами В и Г. Если выберете В, 400 пациентов умрут. Если Г, есть шанс один к трем, что никто не умрет, и шанс два к трем, что умрут 600 пациентов. На какое падет выбор?

Скорее всего, вы заметили, что ожидаемый результат В идентичен варианту А, а результат лекарства Б соответствует препарату Г. Тем не менее хотя вы раньше, вероятно, склонялись к лекарству А, сейчас вы подумываете выбрать Г, а не В.

Когда потенциальная выгода очевидна, люди склонны не рисковать. В то же время, когда те же самые лекарства описаны с точки зрения потерь, бо́льшая часть людей готовы рискнуть жизнями 600 людей, применив лекарство Г, точно зная, что 400 умрут при применении лекарства В. Когда потенциальные риски очевидны, люди склонны к ним в большей степени.

Эффект фрейминга – очень мощное когнитивное искажение. Оно остается в силе, даже когда мы подробно его изучаем, глядя ему в лицо. Впервые я познакомился с этой задачкой 25 лет назад и могу честно сказать: до сих пор лекарства А и Г нравятся мне больше, чем Б и В. Разумеется, это предпочтение иррационально.

На самом деле различные версии известной задачи обрамления (потерянные/спасенные жизни) воспроизводились во многих экспериментах, и раз за разом подтверждалось: при выборе между результатами, представленными с точки зрения положительных исходов, люди рискуют меньше (выбрав А), но выбирая между потерями, они готовы рискнуть (выбрав Г). Говорят, обрамление спасенными жизнями и обрамление потерями логически равны, что делает ответы большинства нелогичными. Тем не менее, если внимательнее рассмотреть формулировку вопроса, вы заметите, что рискованные варианты более четко сформулированы, в отличие от более безопасных. Например, «безопасная» версия лекарства А утверждает: 200 человек спасутся, но в условиях не сказано, что оставшиеся 400 – нет. Хорошие новости в следующем: когда экспериментаторы полностью сформулировали более безопасные варианты, различие между стремлением рисковать при негативном обрамлении (потери) и стремлением избегать рисков при позитивном (спасенные жизни) исчезло[105]105

Kühberger, A. «The framing of decisions: A new look at old problems». Organizational Behavior and Human Decision Processes, 62, 230–240, 1995;

Kühberger, A., Gradl, P. «Choice, rating, and ranking: Framing effects with different response modes». Journal of Behavioral Decision Making, 26, 109–117, 2013;

Kühberger, A., Tanner, C. «Risky choice framing: Task versions and a comparison of prospect theory and fuzzy-trace theory». Journal of Behavioral Decision Making, 23, 314–329, 2010;

Mandel, D. R. «Gain-loss framing and choice: Separating outcome formulations from descriptor formulations». Organizational Behavior and Human Decision Processes, 85, 56–76, 2001;

Mandel, D. R. «Do framing effects reveal irrational choice?» Journal of Experimental Psychology: General, 143, 1185–1198, 2014;

Seta, J. J., Seta, C. E., McCormick, M. «Commonalities and differences among frames: A unification model». Journal of Behavioral Decision Making, 30, 1113–1130, 2017;

Tombu, M., Mandel, D. R. «When does framing influence preferences, risk perceptions, and risk attitudes? The explicated valence account». Journal of Behavioral Decision Making, 28, 464–476, 2015.

[Закрыть]. Это важное открытие иллюстрирует саму суть обнаружения чуши: обладая неполной информацией (или чушью), всегда лучше постараться дополнить информацию, до того как приходить к каким-то выводам или принимать решения.

Несмотря на все это, в супермаркете я не выберу замороженный йогурт с жирностью 20 %. Но если увижу такой же, на котором написано «обезжиренный на 80 %», он неожиданно покажется привлекательным: я вообще возьму три. Чушь может создавать такие же обманчивые когнитивные искажения, если мыслить, опираясь на неполную или ложную информацию.

Эмоциональная чушеверность: Что мы чувствуем

Влияет ли наше текущее настроение на подверженность чуши, которую несут другие? Любой, кто занимается изучением эмоций, скажет вам, что они проникают во все аспекты жизни, влияя на когнитивные и поведенческие стратегии, включая то, как мы воспринимаем обман.

В одном исследовании австралийский социальный психолог Джозеф Форгас влиял на настроение участников, а затем оценивал, связаны ли их эмоции со способностью обнаружить обман. Одна треть испытуемых смотрели десятиминутный отрывок британского комедийного сериала, другая – документальный фильм о природе, а последняя треть – отрывок художественного фильма про смертельно больного раком человека. Эти записи отвечали за радостное, нейтральное или грустное состояние участников соответственно. После манипуляции настроением участникам показывали видео людей, которые на допросе отрицали обвинения в совершении кражи, искренне и нет. Затем респонденты должны были высказать свое суждение: виноваты ли люди в краже и были ли они честны на допросе. Форгас обнаружил, что радостные участники с большей вероятностью ошибались при определении обмана. При этом грустные участники с большим скептицизмом подходили к заданию и более точно выявляли обман[106]106

Forgas, J. P., East, R. «On being happy and gullible: Mood effects on skepticism and the detection of deception». Journal of Experimental Social Psychology, 44, 1362–1367, 2008.

[Закрыть].

Форгас предполагал, что настроение участников действует на их способность определять обман по двум причинам. Во-первых, оно влияет на то, какие воспоминания могут прийти в голову. В хорошем настроении человек с большей вероятностью вспомнит примеры более положительных и доверительных ситуаций, в то время как в плохом – связанные со скептицизмом или неприятием. В ряде эмпирических исследований также обнаружили наличие предрассудков в области социальных предубеждений, обусловленных эмоциями, что согласуется с механизмом влияния эмоций на суждения. Во-вторых, исследования, проводимые до этого, показали: настроение влияет на то, как мы обрабатываем информацию. Чаще всего люди в плохом настроении склонны внимательнее и более систематически рассматривать данные, что увеличивает шансы выявить обман. С другой стороны, люди в хорошем склонны судить более поверхностно, в связи с чем больше рискуют быть обманутыми.

В своем исследовании Форгас предполагает: помимо ситуационных факторов, таких как усталость, рассеянное внимание и высокая когнитивная нагрузка, на снижение вероятности обнаружить намеки на чушь влияют и ярко выраженные эмоциональные состояния. В общем, неудивительно, что подобный опыт влияет на то, принимаем мы чушь или отвергаем ее.

Тем не менее есть и другие варианты влияния эмоций на уровень чушеверности. Представьте следующую ситуацию:

Вы решили инвестировать в фондовый рынок. Хотя и подготовились, и даже думали купить несколько акций, в итоге вы решили инвестировать в акции А. Спустя год получили прибыль в 0,10 % с вашей доли. Не тот результат, на который вы рассчитывали, но хотя бы ничего не потеряли. Конечно, нельзя удержаться от того, чтобы не проверить курс других акций, которые вы собирались купить. И вы замечаете, что заработали бы в 10 раз больше, если бы инвестировали в акции Б. Что вы чувствуете?

Если вы похожи на большинство, то не особо обрадуетесь, что акции Б принесли бо́льшую прибыль по сравнению с акциями А, и оцените предыдущее решение негативно. Тем не менее, обнаружив, что акции Б упали в цене и вы потеряли деньги, инвестировав в них, вы бы обрадовались решению инвестировать в акции А.

Люди склонны оценивать верность информации в тесной связи со своим эмоциональным откликом на нее. Нравится мне или нет, что эта информация говорит обо мне, о моих любимых или нашем будущем? Таким же образом люди склонны оценивать верность решений, опираясь на эмоциональную реакцию на последствия решений. Подобная склонность называется «предвзятость результата», поскольку на оценку решений скорее действуют их результаты, а не разумность собственно решения[107]107

Baron, J., Hershey, J. C. «Outcome bias in decision evaluation». Journal of Personality and Social Psychology, 54, 569–579, 1988;

Seta, C. E., Seta, J. J., Petrocelli, J. V., McCormick, M. «Even better than the real thing: Alternative outcome bias affects decision judgements and decision regret». Thinking and Reasoning, 21, 446–472, 2015.

[Закрыть]. Даже когда люди видят вероятность успеха до принятия решения (например, у акций А был 70 %-ный шанс принести прибыль, а у акций Б был 15 %-ный шанс), они не могут не воспринимать свой выбор акций А как плохое решение, если обнаружится, что акции Б принесли больше. Наш эмоциональный ответ на произошедшие и не произошедшие события оказывает огромное влияние на наши взгляды и решения, при этом не затрагивая информацию, которую мы использовали для принятия решения.

Другими словами, люди легко забывают о разумности принятого решения, как только сталкиваются с его последствиями.

Мошенники используют это. Они пытаются показать, какой чудесной станет жизнь, как только мы приобретем то, что они хотят продать, и какой унылой будет, если ничего не купим. Как сказал Чарльз Киндлбергер, специалист в области истории экономики: «Нет ничего более тревожного для нашего благополучия и убеждений, чем смотреть, как богатеют друзья»[108]108

Киндлбергер, Ч. Мировые финансовые кризисы. Мании, паники и крахи. – Питер, 2010.

[Закрыть]. Играя на эмоциях, можно спровоцировать окружающих потратить приличные деньги на очередную крайне важную вещь.

Мотивационная чушеверность: Выбор чуши вместо правды и фактов

Еще одна причина, по которой люди подвержены влиянию чуши, заключается в том, что иногда они мотивированы игнорировать правду. Сильнейшие социальные мотивации, которые есть у людей, включают в себя стремление к чувству принадлежности и принятия окружающими, желание быть постоянным в своих мыслях и поведении и необходимость иметь оправдания для собственного поведения[109]109

Аронсон, Э. Общественное животное. Введение в социальную психологию. – Аспект Пресс, 1998.

[Закрыть]. Неявное стремление к данным вещам способно сделать нас еще уязвимее для всякой брехни, например когда мы неловко стоим у дверей лифта с группой людей, так и не нажав кнопку вызова.

Роберт Шиллер, экономист, писал, что базовый механизм, подкрепляющий успех схемы Понци, – наше стремление подражать поведению других, особенно в вещах, которые мы не до конца понимаем[110]110

Шиллер, Р. Иррациональный оптимизм: Как безрассудное поведение управляет рынками. Альпина Паблишер, 2013.

[Закрыть]. В случае с инвестициями в фонд Мейдоффа тот факт, что большое количество людей, казалось, зарабатывало огромные суммы и рассказывало о своих успехах другим, привел к тому, что последующие инвестиции казались безопасными и слишком выгодными, чтобы упустить такой шанс. Помимо этого, раз «все делали», любой показался бы почти дураком, не последовав примеру.

Возьмем классическую демонстрацию силы конформизма, проведенную психологом Соломоном Ашем[111]111

Asch, S. E. «Effects of group pressure upon the modification and distortion of judgment». В Groups, leadership, and men (In H. Guetzkow Eds.), 76–92, Carnegie Press, 1951.

[Закрыть]. В его исследовании участникам показывали линию (приложение 1) и задавали вопрос, на какую из других – А, Б или В – (приложение 2) она больше всего похожа. Как вы можете видеть, ответ, в общем-то, очевиден.

Тем не менее члены группы (в которой пять человек были студентами университета, сотрудничавшими с экспериментаторами) специально вслух давали неправильный ответ, один за другим, в различных испытаниях, похожих на приведенное выше. Тогда, собственно, участники сталкивались со следующей дилеммой: правильный ответ был очевиден, но дать его – значило пойти против группы. Поддаться конформизму и повести себя как остальные было бы проще, но в таком случае пришлось бы ответить очевидно неправильно.

Аш предполагал, что респонденты проигнорируют вопиюще неправильные ответы подсадных участников и ответят верно. Однако этого не произошло. 76 % соглашались несмотря на ошибочность. Бо́льшая часть поддалась влиянию в 1–3 случаях из 12 испытаний, где группа давала неправильный ответ. При этом значительное число респондентов поддавались влиянию группы практически каждый раз.

В одной важной дополнительной версии исследования Аша[112]112

Там же.

[Закрыть] участникам говорили, что они опоздали в лабораторию на эксперимент и поэтому на вопросы будут отвечать письменно и конфиденциально. В таком случае, когда не надо было отвечать вслух и при других людях, они редко поддавались влиянию очевидно неверных ответов, данных остальными. Подобная версия эксперимента Аша показывает, что участники на самом деле отлично видели реальное положение дел, однако свободно могли высказать то, что думают, только на условиях конфиденциальности. Респонденты знали, что другие не правы, но соглашались, не желая быть исключенными из группы.

Эксперимент показал: стремление быть принятым в сообщество оказывает на нас огромное влияние. Люди могут придерживаться различных мнений, держа это в тайне, но при этом публично соглашаясь с бессмыслицей, которую вещает толпа, чтобы не выделяться. Поступая аналогично, мы остаемся чушеверными, а это намного проще, чем высовываться, и удовлетворяет стремление к принадлежности.

Для людей, старающихся сделать все, чтобы подкрепить убеждения лучшими из имеющихся доказательств, мотивированная чушеверность может казаться очень странной. Они часто ошибаются, думая, будто все, что нужно людям, – веское доказательство, и тогда-то они перестанут покупаться на брехню. Те, кто верит в чушь в связи с когнитивными или контекстуальными причинами, могут адекватно отреагировать на представленные доказательства. Однако это не касается людей, убежденность которых в чуши подкреплена какой-то мотивацией. Никакое количество доказательств не изменит их веру, потому что они выбрали именно это убеждение. Как только вы осозна́ете, что кто-то не собирается подкреплять свои убеждения доказательствами, то поймете: их проблема никак не связана с отсутствием веских аргументов.

Лакмусовой бумажкой для мотивационной чушеверности является простой вопрос: «Если можно без тени сомнения доказать, что А – неверно, а Б – верно, поверите ли вы, что Б – истина?» Если человек отвечает «нет», знайте: их выбор чуши обусловлен какой-то мотивацией. В таком случае нет смысла продолжать спорить. Ваш подход к решению вопроса с использованием фактов встретит только больше сопротивления, и вы столкнетесь с еще большей порцией глупости[113]113

Batson, C. D. «Rational processing or rationalization? The effect of disconfirming information on a stated religious belief». Journal of Personality and Social Psychology, 32, 176–184, 1975;

Lord, C. G., Ross, L., Lepper, M. R. «Biased assimilation and attitude polarization: The effects of prior theories on subsequently considered evidence». Journal of Personality and Social Psychology, 37, 2098–2109, 1979;

Knowles, E. S., Linn, J. A. (ред.) Resistance and persuasion. Erlbaum, 2004; Nyhan, B., Reifler, J. «When corrections fail: The persistence of political misperceptions». Political Behavior, 32, 303–330, 2010.

Эффект обратного результата может быть не таким масштабным, как мы когда-то полагали, см.: Chan, M.S., Jones, C. R., Jamieson, K. H., Albarracin, D. «Debunking: A meta-analysis of the psychological efficacy of messages countering misinformation». Psychological Science, 28, 1531–1546, 2017; Douglas, K. M., Uscinski, J. E., Sutton, R. M., Cichocka, A., Nefes, T., Ang, C. S., Deravi, F. «Understanding conspiracy theories». Political Psychology, 40 (Suppl 1), 3–35, 2019;

Wood, T., Porter, E. «The elusive backfire effect: Mass attitudes’ steadfast factual adherence». Political Behavior, 41, 135–163, 2019.

[Закрыть].

Грустная правда заключается в том, что невероятно маленькое количество людей формируют свои убеждения и высказывают их только после внимательного исследования всех доказательств[114]114

Boghossian, P., & Lindsay, J. How to have impossible conversations: A very practical guide. Lifelong Books, 2019;

Haidt, J. «The emotional dog and its rational tail: A social intuitionist approach to moral judgment». Psychological Review, 108, 814–834, 2001;

Шермер, М. Тайны мозга. Почему мы во все верим. – Эксмо, 2015;

Tappin, B. M., van der Leer, L., McKay, R. T. «The heart trumps the head: Desirability bias in political belief revision». Journal of Experimental Psychology: General, 146, 1143–1149, 2017.

[Закрыть].

Несмотря на то что аргументы, приводимые в подкрепление чьего-то мнения, зачастую неправильно воспринимают как факты, бо́льшая часть убеждений сформирована под влиянием субъективных эмоциональных реакций, а не на базе внимательного изучения доказательств. Ошибочное приравнивание аргумента к доказательству только усложняет задачу для людей, которые не особо озабочены их поиском. Они склонны подтверждать свои идеи, изучая данные, которые подкрепляют их выводы. Выбирая подходящие доказательства, мы не приблизимся к истине. Можно легко поверить в то, что мы хотим считать правдой, используя те же когнитивные искажения, которые делают нас более чушеверными[115]115

Kunda, Z. «The case for motivated reasoning». Psychological Bulletin, 108, 480–498, 1990.

[Закрыть].

Психический дискомфорт, вызванный наличием двух противоречивых мыслей, социальные психологи называют «когнитивным диссонансом»[116]116

Фестингер, Л. Теория когнитивного диссонанса. – Ювента, 1999.

[Закрыть]. Искусство проверять спорные убеждения противоречит стремлению верить в них, потому что проверка фактов может стать опровержением. Люди склонны стремиться к избеганию когнитивного диссонанса или к его уменьшению, если он все-таки возник. Вместо того чтобы признать ошибки и отказаться от убеждений, основанных на чуши, люди еще активнее цепляются за них и рационализируют противоречивые доказательства, чтобы уменьшить диссонанс[117]117

Shermer, M. «Why people believe conspiracy theories». Skeptic, 25(1), 12–17.

[Закрыть]. По тем же причинам, хотя консерваторы вроде и знают, что папа римский не одобрял кандидатуру Дональда Трампа во время его предвыборной кампании и Хиллари Клинтон не руководила клубом педофилов в пиццериях Вашингтона, они очень хотят, чтобы это было правдой[118]118

Ritchie, H. «Read all about it: The biggest fake news stories of 2016». CNBC, 30 декабря 2016 г.: https://www.cnbc.com/2016/12/30/read-all-about-it-the-biggest-fake-news-stories-of-2016.html; Schaedel, S. «Did the Pope endorse Trump?» FactCheck.org, 24 октября 2016 г.: https://www.factcheck.org/2016/10/did-the-pope-endorse-trump/;

Samuelson, K. «What to know about Pizzagate: The fake news story with real consequences». Time, 5 декабря 2016 г.: https://time.com/4590255/pizzagate-fake-news-what-to-know/;

Effron, D. A. «It could have been true: How counterfactual thoughts reduce condemnation of falsehoods and increase political polarization». Personality and Social Psychology Bulletin, 44, 729–745, 2018; Manjoo, F. True enough: Learning to live in a post-fact society. John Wiley & Sons, 2008.

[Закрыть]. Все люди избегают диссонанса, не проверяя факты, подкрепляющие данное мнение. Они скорее поверят в эту глупость, потому что она согласуется с тем, во что они стремятся верить по поводу этих кандидатов.

Хотя убеждения, подкрепленные чушью, могут устоять против научных доказательств, так не должно быть. Желание держаться за брехню приведет только к большей чушеверности, неоптимальным суждениям и невыгодным решениям.

Внимание! Это не конец книги.

Если начало книги вам понравилось, то полную версию можно приобрести у нашего партнёра - распространителя легального контента. Поддержите автора!Правообладателям!

Данное произведение размещено по согласованию с ООО "ЛитРес" (20% исходного текста). Если размещение книги нарушает чьи-либо права, то сообщите об этом.Читателям!

Оплатили, но не знаете что делать дальше?