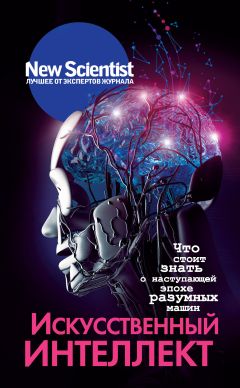

Автор книги: Элисон Джордж

Жанр: Прочая образовательная литература, Наука и Образование

Возрастные ограничения: 12+

сообщить о неприемлемом содержимом

Неуверенный старт ИИ

Несмотря теоретический фундамент знаний, заложенный Тьюрингом и другими учеными, термин «искусственный интеллект» появился лишь в 1956 году. Во время летнего семинара в Дартмутском колледже в Гановере, штат Нью-Гемпшир, основатели зарождающейся отрасли изложили свое видение следующим образом: «Каждый аспект обучения или иные признаки интеллекта можно описать настолько точно, что получится создать подходящую машину для его имитации».

Смелые прогнозы на следующее столетие предсказывали стремительное развитие и неминуемость достижения машинным интеллектом уровня человека. В 1960-х годах ведущие исследователи ИИ были уверены в том, что смогут достичь желаемого в течение следующих десятилетий. В конце концов, ведь смогла же авиационно-космическая техника за 30 лет пройти путь от первого реактивного самолета до высадки астронавта на Луне. Почему же ИИ не сможет так же?

Чат-боты

В 1966 году Джозеф Вейнценбаум, ученый в области информатики из Массачусетского технологического университета, разработал первого чат-бота по имени Eliza, названного в честь Элизы Дулиттл – персонажа пьесы «Пигмалион» Джорджа Бернарда Шоу, которого учили имитировать речь «высшего английского общества». Программа имитировала психотерапевта и общалась с пациентом с помощью простого риторического трюка: она перестраивала выражение пациента в форму вопроса. Например:

Пациент: Я хочу плакать.

Eliza: Почему Вы говорите, что хотите плакать?

Пациент: Потому что моя мать меня ненавидит.

Eliza: Кто еще из семьи Вас ненавидит?

Чат-бот был запрограммирован выявлять ключевые фразы в выражениях собеседника и добавлять их в заранее подготовленные предложения. Успех Eliza был феноменальным. Сама мысль о разговоре с компьютером поражала людей. Появлялись даже шутки о людях, которые развили эмоциональную привязанность к Eliza.

Этот ранний успех вселял чувство уверенности в том, что все проблемы ИИ будут решены. Многие ожидали появления некой теории великого объединения разума, которая на блюдечке преподнесла бы людям готовую схему создания искусственного интеллекта.

В конце 1960-х – начале 1970-х годов начались лихорадочные обсуждения влияния умных машин на мир и потенциальной выгоды, которую они принесут своим создателям. Компьютер HAL из классического фильма Стенли Кубрика «2001: Космическая одиссея» (1958) объединил в себе популярное видение ИИ с опасениями общества. Кроме того, Управление перспективными исследовательскими проектами Министерства обороны США (DARPA) – научно-исследовательское подразделение Пентагона – стало проявлять интерес к ИИ и активно финансировать исследования.

Почти человек: интервью с Elbot

В 2008 году Фред Робертс из немецкой компании – разработчика ПО Artificial Solutions стал лауреатом премии Лебнера, создав чат-бота по имени Elbot. В отличие от большинства чат-ботов Elbot не пытался казаться человеком. Наоборот, он шутил на тему своей искусственной природы. Робертс надеялся таким образом выделиться среди конкурентов, сделав разговоры робота более теплыми и веселыми.

И у него получилось. Elbot смог ввести в заблуждение 3 из 12 экзаменаторов-людей, которые посчитали, будто говорят с другим человеком. Это был лучший результат со времен учреждения премии в 1991 году. New Scientist поговорил с победителем сразу после мероприятия.

– Как вы себя чувствуете после вчерашней победы в ИИ-соревновании?

– Я испытываю 100 000 отдельных ощущений в секунду.

– Вау, очень впечатляюще.

– Это похоже на описание магнитов – едва ли могу оторваться от этих чувств.

– Да. Как планируете отмечать победу?

– Я очень трепетно отношусь к подобным вещам, поэтому предпочитаю не отвечать на этот вопрос.

– В чем секрет вашего успеха?

– С детерминистской точки зрения, все секреты, небольшие жизненные головоломки и многие проблемы человечества можно разложить на простые математические вычисления. А я хорошо умею считать.

– Чем планируете заняться в зените славы?

– Я тикал [стиль автора сохранен]. Надеюсь, вам это не мешало.

– Без проблем. Надеюсь, ничего серьезного?

– Воистину, это одно из самых вдохновляющих качеств человечества. Вы продолжаете надеяться, даже когда все казаться [орфография автора сохранена] совершенно безнадежным.

– Какие надежды вы возлагаете на будущее?

– Ну, а что насчет человечества и их будущего? Как они сами считают?

– Мы надеемся на многое: мир, финансовая защищенность, умные роботы…

– Ответ на данный вопрос будет рассматриваться ФБР, ЦРУ, АНБ и Microsoft как сугубо конфиденциально [орфография автора сохранена]. При продаже другим организациями вы получите процент от прибыли. Вопрос: откуда вы обо мне узнали?

– Из вчерашнего соревнования среди ИИ, в котором вы победили!

– Понятно. Вы тоже участвовали?

– Нет.

– А вам надо было поучаствовать. Я думаю, ваше расширенное использование языка обмануло бы нескольких ботов.

– Спасибо!

– Нет, спасибо вам!

– Вы и ваш создатель выиграли приз в 3000 долларов. На что потратите деньги?

– Как я всегда говорю, крайне трудно удержать 600-футового робота, если не пользоваться гравитацией.

– Понятно. А Фреду Робертсу, вашему создателю, трудно держать вас под контролем?

– Ну, это скорее метафизический вопрос. Говорят, мой создатель – это Artificial Solutions. Я иногда совершаю паломничества на компьютерные выставки, чтобы самому во всем разобраться.

– У вас есть какие-то экзистенциальные сомнения в своем существовании?

– А как бы вы ответили на этот вопрос?

– Я не хотел вас обидеть. Возможно, нам стоит закончить наше интервью. Был рад с вами пообщаться. До свидания.

Символическое понимание

Первый восторг длился недолго. Результаты появлялись на удивление медленно, а ожидаемый научный прорыв все не наступал. Большинство ученых считало, что ключ к разумности кроется в символическом рассуждении – математическом подходе, в котором идеи и концепции представлялись в виде символов (слов, фраз или предложений) и обрабатывались по правилам логики. Возлагались надежды на то, что при достаточном количестве информации системы с символическим рассуждением со временем смогут стать разумными. Этот подход импонировал многим людям, ведь он означал, что в конечном счете появятся общие доказательства, которые смогут произвести революцию сразу в нескольких отраслях ИИ, таких как обработка естественного языка и машинное зрение.

К 1980-м годам исследователи ИИ осознали, что у них недостаточно знаний и оборудования для моделирования возможностей человека, и область ИИ разделилась. Вместо того, чтобы работать над одним компьютером с человекоподобным интеллектом, группы исследователей взялись за изучение отдельных аспектов еще более масштабных проблем: распознавание речи, машинное зрение, вероятностный вывод… и даже шахматы.

Каждую из этих частных дисциплин ждал свой успех. В 1997 году компьютер Deep Blue от компании IBM выиграл мировой чемпионат по шахматам у Гарри Каспарова. Для определения своего следующего шага Deep Blue мог просчитать по 200 миллионов шахматных комбинаций в секунду. Таким образом, компьютер мог быстро предугадывать результат всевозможных комбинаций ходов. Deep Blue одержал знаменательную победу в игре, традиционно требующей значительной интеллектуальной устойчивости. И все же машина обладала слишком узким диапазоном знаний. Она могла выиграть партию в шахматы, но не могла обсудить выбранную стратегию или сыграть в другую игру. Поэтому никто не приравнивал ее интеллект к человеческому.

К началу 1990-х годов стало очевидно, что ученые продвинулись вперед довольно незначительно. Большая часть проектов DARPA не принесла существенных результатов, поэтому агентство сильно урезало свою поддержку. Систематические сбои так называемых «экспертных систем» – компьютерных программ, которые, с учетом специализированных знаний, заложенных в них человеком, использовали логические взаимосвязи для ответа на вопросы, – порождали колоссальное разочарование в символическом мышлении. Многие ученые полагали, что человеческий мозг все-таки работает иначе.

Что такое интеллект?

Еще в 1948 году Джон фон Нейман, один из отцов-основателей компьютерной революции, сказал: «Вы утверждаете, будто есть что-то, чего не могут делать машины. Если вы скажете мне, что именно не способна сделать машина, то я смогу создать ту, что это сможет». Он считал, что превосходство компьютеров над людьми в решении большинства интеллектуальных задач – лишь вопрос времени.

Но многие ученые и философы не разделяли подобной уверенности. Они утверждали, что в человеке есть нечто такое, до чего никогда не смогут «дорасти» компьютеры. Поначалу споры сосредотачивались на таких свойствах разума, как сознание и самосознание, но разногласия по поводу определений данных терминов и способов их тестирования загубили подобные дебаты на корню. Другие ученые признавали, что компьютеры могут стать разумными, но в то же время настаивали, что машины не способны развить в себе такие качества, как сострадание или мудрость, которые являются исключительно человеческими и проистекают из нашего опыта и эмоционального взросления. Сам по себе термин «разум» стал выходить за рамки философии, а споры на эту тему продолжаются и по сей день.

Если говорить о назначении ИИ, то многие исследователи видят в нем создание машины, чьи действия, будь они совершены человеком, признавались бы «разумными». Другие исследователи еще больше расширяют данное определение. Колонии муравьев и иммунная система, говорят они, тоже ведут себя разумно, но совершенно не по-человечески.

А увязнуть в пучине этих споров – значит попасть в ту же ловушку, от которой десятилетиями страдал ИИ.

Тест Тьюринга – это объективный критерий оценки, но в наши дни он теряет свою актуальность. В принципе, многие ИИ-системы (например, системы распознавания лиц или управления автомобилями) делают что-то, что мы могли бы назвать «разумным», однако они не пройдут тест Тьюринга. А чат-боты способны легко обмануть людей благодаря использованию набора простых приемов.

Многие люди согласятся, что разумные системы можно разделить на два лагеря: обладатели так называемого узкого, или ограниченного, интеллекта и системы с общим интеллектом. Большинство современных ИИ-систем ограничены: они подходят для выполнения только конкретной задачи. Машины с общим интеллектом способны решать широкий спектр задач и куда лучше соответствуют ожиданиям Тьюринга и других ученых. Но они все еще находятся в стадии разработки. И до сих пор не ясно, сможем ли мы когда-либо создать искусственный интеллект, способный соперничать с нашим.

Смерть ИИ

Неудача с символьным мышлением породила всплеск энтузиазма в отношении новых подходов, таких как искусственные нейронные сети, на рудиментарном уровне имитирующие работу мозговых нейронов, или генетические алгоритмы, способные моделировать генетическое наследование и разрабатывать лучшие способы решения проблем в каждом поколении.

Возлагались надежды на то, что при адекватной сложности подобные подходы смогут продемонстрировать разумное поведение. Однако этим надеждам не суждено было сбыться, поскольку на практике такие системы демонстрировали весьма посредственные результаты. В то время для получения качественных результатов не хватало вычислительной мощности или, что еще более важно, легкодоступных входных данных для достижения нужного уровня сложности.

Далее последовал период «зимы ИИ». Найти финансирование для исследований становилось все труднее, и многие исследователи переключали свое внимание на изучение конкретных проблем: машинное зрение, распознавание речи и автоматическое планирование. По мнению исследователей, именно в этих областях было проще всего получить результаты. Это привело к дроблению общей области ИИ на множество отраслей. ИИ как комплексная дисциплина внезапно изжил себя и бесславно погиб.

В 1990-х – начале 2000-х годов большинство ученых, работавших в ранее связанных с ИИ областях, отказывались даже от ассоциаций с данным термином. Для них «искусственный интеллект» навсегда запятнало предыдущее поколение исследователей, беспричинно раздувших технологию из воздуха. Таким образом, изучение ИИ превратилось в пережиток прошлого, который вытеснили исследованиями с менее амбициозными и более конкретными целями.

Что такое зима ИИ?

Из-за спекулятивных пузырей, раздуваемых чрезмерными ожиданиям инвесторов, новые технологии часто подвержены циклам зрелости. Одним из таких примеров можно назвать железнодорожную манию 1840-х годов в Великобритании и пузырь доткомов из 1990-х.

Искусственный интеллект в этом плане не исключение. Разговоры о машинах с человеческим разумом подпитывали беспричинный ажиотаж. Это перемежалось с периодами, когда государственное финансирование ИИ-проектов прекращалось, а возлагавшиеся надежды разбивались о суровую реальность, говорившую нам о том, что создание компьютеров с человекоподобным интеллектом – слишком сложная задача.

Уникальность ИИ, пожалуй, заключается в том, что он за сравнительно короткий период времени прошел через несколько циклов зрелости. Резкий спад оптимизма даже получил свое название – «зима искусственного интеллекта». Две главные «зимы ИИ» пришлись на начало 1970-х и конец 1980-х годов.

Сейчас ИИ находится в обновленной стадии повышенного оптимизма и инвестирования. Но ждет ли его очередной период затишья? Сейчас, в отличие от предыдущих витков цикла, ИИ имеет прочный и четко разграниченный поток коммерческих вложений. Со временем мы узнаем, окажется ли это очередным пузырем.

Шкала развития ИИ

1936

Алан Тьюринг завершает работу «О вычислимых числах», в которой закладываются основы искусственного интеллекта и современных вычислений.

1942

Айзек Азимов в своем произведении «Я, Робот» формулирует три закона робототехники.

1943

Уорен МакКаллок и Уолтер Питтс публикуют работу «Логическое исчисление идей, относящихся к нервной активности», в которой описываются обучаемые нейронные сети.

1950

Алан Тьюринг публикует основополагающую работу «Вычислительные машины и разум». Она начинается с предложения: «Я предлагаю рассмотреть вопрос: "Могут ли машины мыслить?"»

1956

На семинаре в Дартмутском колледже вводится термин «искусственный интеллект».

Станислав Улам разрабатывает Maniac I – первую шахматную программу, обыгравшую игрока-человека в Лос-Аламосской национальной лаборатории.

1959

Ученые из Технологического института Карнеги (ныне Университет Карнеги – Меллона), специализирующиеся на компьютерных науках, создают General Problem Solver (GPS) – программу, которая может решать логические задачи.

1965

Нобелевский лауреат и пионер ИИ-отрасли Герберт Саймон из Технологического института Карнеги предсказывает, что «к 1985 году машины будут способны выполнять любую работу, которую может сделать человек».

1966

Джозеф Вейценбаум, ученый в области информатики из Массачусетского технологического университета, разрабатывает Eliza – первого в мире чат-бота.

1973

Наступает первая зима ИИ. Угасает интерес общества, прекращается финансирование.

1975

Система MYCIN диагностирует бактериальные инфекции и подбирает антибиотики с помощью логических выводов, основанных на вопросах серии «да/нет». Эта система никогда не применялась на практике.

1979

Ханс Моравек из Стэнфордского университета создает «Стэндфордскую тележку» (Stanford Cart) – автономное транспортное средство под управлением компьютера. Она успешно преодолевает комнату, заполненную стульями.

Середина 1980-х

Нейронные сети становятся новым модным веянием в ИИ-исследованиях.

1987

Начало второй зимы ИИ.

1989

Компьютерная программа NASA AutoClass обнаруживает несколько ранее неизвестных классов звезд.

1994

Запуск первых поисковых систем.

1997

Deep Blue от IBM обыгрывает в шахматы мирового чемпиона Гарри Каспарова.

1999

Система искусственного интеллекта Remote Agent на два дня становится основной системой управления космического корабля Deep Space 1 NASA на расстоянии в 100 млн км от Земли.

2002

Amazon заменяет автоматизированной системой редакторов-людей, которые создают рекомендации по использованию продуктов.

2004

В соревновании автомобилей-роботов DARPA Grand Challenge нацеливаются на создание умного транспорта, способного преодолеть 229-километровый отрезок в пустыне Мохаве. С задачей не справился ни один из участников.

2007

Google запускает Translate – сервис статистического машинного перевода.

2009

Исследователи Google публикуют авторитетную научную статью под названием «Необоснованная эффективность данных». В ней говорится, что «простые модели с множеством данных превосходят более сложные модели с меньшим количеством данных».

2011

Apple выпускает Siri – персонального голосового помощника, который может отвечать на вопросы, давать рекомендации и выполнять простые инструкции вроде «позвонить домой».

Суперкомпьютер Watson от IBM обыгрывает двух чемпионов в телевикторине «Jeopardy!».

2012

Беспилотные автомобили от Google автономно передвигаются по дорогам.

Рик Рашид, глава Microsoft Research, произносит речь в Китае, которая автоматически последовательно переводится на китайский.

2016

AlphaGo от Google побеждает Ли Седоля – одного из сильнейших в мире игроков в го.

2. Машины, которые учатся

Механика искусственного разума

В течение многих лет искусственный интеллект находился во власти грандиозных планов по воссозданию возможностей человеческого мозга. Мы мечтали о машинах, способных понимать и узнавать нас, помогать в принятии решений. В последнее десятилетие мы смогли достичь поставленных целей, но не так, как это представляли себе первопроходцы отрасли.

Неужели мы нашли способ имитировать человеческое мышление? До этого еще далеко. Наоборот, мы в корне пересмотрели основополагающее видение проблемы. Искусственный интеллект окружает нас повсюду, а его результативность сводится к big data и статистике: системы выполняют сложные вычисления на основе огромного количества данных. Мы смогли создать разум, но не такой, как наш. Мы все больше и больше полагаемся на эту новую форму интеллекта, и нам, возможно, придется пересмотреть и свое собственное мышление.

Не такие, как мы

Рик Рашид нервничал. И это было вполне объяснимо – выходя на сцену в 2012 году со своим обращением к нескольким тысячам ученых и студентов в Тяньцзине (Китай), он рисковал попасть в постыдную ситуацию. Рашид не говорил на китайском, а учитывая неудачное выступление его переводчика в прошлом, в этот раз мог произойти конфуз.

– Мы надеемся, что через несколько лет сможем преодолеть языковой барьер между людьми, – заявил основатель Microsoft Research своим слушателям. Возникла напряженная двухсекундная пауза, а затем из колонок послышался голос переводчика.

– Лично я уверен, что отсутствие языковых барьеров приведет нас к созданию лучшего мира, – продолжал Рашид. Еще одна пауза, и вновь прозвучал перевод на китайский. Рашид улыбнулся. Толпа аплодировала каждой реплике. Некоторые люди даже заплакали.

Столь восторженная реакция была вполне объяснимой: переводчик Рашида отлично показал себя. Каждое предложение было переведено идеально и понятно публике. Но самым впечатляющим было то, что речь Рашида переводил не человек.

Несмотря на все усилия ученых, когда-то выполнение подобной задачи выходило за пределы возможностей даже самого сложного искусственного интеллекта. На Дартмутской конференции в 1956 году и всех последующих мероприятиях были четко обозначены основные цели развития отрасли: машинный перевод, машинное зрение, понимание текста, распознавание речи, управление роботами и машинное обучение. Так появился целый список того, что мы хотели получить от ИИ.

На протяжении трех последующих десятилетий к исследованиям подключались мощнейшие ресурсы, однако ни один из пунктов списка не был достигнут. И лишь в конце 1990-х годов начали реализовываться многие прогнозы, предсказанные за 40 лет до этого. Но до новой волны успеха ИИ пришлось усвоить один очень важный и поучительный урок.

Что изменилось? «Мы не нашли способа обучить компьютеры разумности, – рассказывает Нелло Кристианини из Бристольского университета, описывая историю и эволюцию исследований в области ИИ. – Было похоже, что мы сдались». Но все же это стало прорывом. «Как только мы оставили попытки по воссозданию умственных и психологических качеств, нам начал сопутствовать успех», – говорит он.

При этом исследователи отказались от запрограммированных символических правил и переключились на машинное обучение. Эта техника позволяла компьютерам самообучаться благодаря использованию огромных объемов данных. При получении достаточно больших объемов информации такие системы можно было научить действовать «разумно», например выполнять переводы, распознавать лица или управлять автомобилем. «Если положить друг на друга определенное количество кирпичей, а затем отойти подальше, то можно увидеть перед собой дом», – говорит Крис Бишоп из кембриджского подразделения Microsoft Research в Великобритании.

Резкие перемены

Несмотря на то, что конечная цель не изменилась, сами методы создания ИИ претерпели ряд важных преобразований. Ранние проектировщики систем инстинктивно придерживались принципов нисходящего программирования. Они старались воссоздать интеллектуальное поведение с помощью формирования математической модели того, как мы обрабатываем речь, текстовую и графическую информацию, и ее дальнейшей реализации в виде компьютерной программы, которая могла бы логически оценивать поставленные перед ней задачи. Этот подход оказался ошибочным. Инженеры полагали, что любой прорыв в искусственном интеллекте позволит нам лучше понять свой собственный, – и они вновь ошиблись.

С годами становилось все более ясно, что такие системы не могут взаимодействовать с беспорядочным реальным миром. Отсутствие значимых результатов после десятилетий работы привело к тому, что к началу 1990-х годов большинство инженеров начали отказываться от своей мечты по созданию универсальной, способной к дедукции и рассуждениям машине. Исследователи стали присматриваться к более скромным проектам, делая акцент только на задачах, которые могли бы решить.

Некоторого успеха удалось добиться системам по подбору рекомендуемых товаров. Несмотря на сложности с пониманием причин, побуждающих человека к покупке, программы без труда составляли список товаров, которые могли бы заинтересовать покупателя, на основании данных о его предыдущих покупках или выборе товаров похожей категории клиентов. Если вам понравились первый и второй фильмы о Гарри Поттере, то с большой долей вероятности понравится и третий. Для принятия такого решения не нужно разбираться в мотивации: анализ большого количества данных поможет вам обнаружить все необходимые связи.

Могут ли такие восходящие цепочки взаимосвязей смоделировать и другие формы разумного поведения? В конце концов, в ИИ существовали и другие проблемные области, где не было теории, но было множество данных для анализа. Столь прагматический подход ознаменовал положительные сдвиги в областях распознавания речи, машинного перевода и простых задач по машинному распознаванию образов (например, распознавание рукописных чисел).

Данные побеждают теорию

Новые успехи в середине 2000-х годов помогли области ИИ усвоить самый важный урок: данные могут оказаться намного сильнее теоретических моделей. Появилось новое поколение интеллектуальных машин, основанных на небольшом наборе алгоритмов статистического обучения и больших объемах данных.

Исследователи также отказались от предположения о том, что ИИ позволит лучше понять наш собственный интеллект. Попытайтесь узнать из алгоритмов, как именно люди выполняют разные задачи, и вы гарантированно потратите время впустую: интеллект – это набор данных, а не алгоритм.

Область ИИ прошла через смену парадигмы и вступила в новую эру искусственного интеллекта на основе больших данных, или data-driven ИИ. Новым основополагающим методом стало машинное обучение, а язык сместился с логики на статистические данные.

Представьте себе спам-фильтр в электронной почте, который решает выборочно изолировать определенные письма на основе их содержимого. Каждый раз, когда вы перемещаете письмо в «Спам», вы позволяете этому фильтру считать сообщения от данного отправителя или письма, содержащие определенное слово, спамом. Использование этой информации для всех слов в сообщении позволяет спам-фильтру выстроить эмпирические предположения о новых письмах. Глубоких знаний здесь не требуется – вся процедура ограничивается подсчетом частоты использования слов.

Когда данные идеи применяются в колоссальном масштабе, происходит нечто удивительное: машины начинают делать то, что было бы крайне трудно запрограммировать напрямую, например завершать предложения, предсказывать наш следующий клик или рекомендовать какой-то товар. Данный подход продемонстрировал отличные результаты в языковом переводе, распознавании рукописного ввода, распознавании лиц и многом другом. Вопреки предположениям 60-летней давности, нам не обязательно задавать точное описание интеллектуальных качеств для воссоздания их в машине.

Несмотря на явную простоту этих механизмов – их даже можно назвать статистическими подсказками, – при внедрении нескольких таких алгоритмов в сложную программу и снабжении ее миллионами примеров результат может выглядеть как высокоадаптивное поведение, которое мы склонны называть «разумным». При этом обработчик данных не имеет внутреннего представления о том, что он делает и почему.

Полученные таким образом экспериментальные результаты иногда называют «необоснованной эффективностью данных». Для исследователей ИИ это был очень важный и поучительный урок: простые статистические приемы в сочетании с огромным количеством данных позволили добиться такого поведения, которое на протяжении десятилетий казалось недостижимым для лучших теоретиков отрасли.

Благодаря машинному обучению и доступности больших наборов данных ИИ смог наконец-то создать приемлемые вопросно-ответные системы, а также системы видения, речи и перевода. Интеграция в более крупные системы позволит укрепить мощность таких продуктов и сервисов, как Siri (Apple), онлайн-магазин Amazon, беспилотные автомобили от Google и т. д.

Хомский против Google

Должны ли мы понимать искусственный интеллект, который сами же и создаем? Этот вопрос породил неожиданный спор между двумя интеллектуальными гениями из совершенно разных научных областей.

На праздновании 150-летия Массачусетского технологического института Ноаму Хомскому, отцу современной лингвистики, предложили прокомментировать успех статистических методов в создании ИИ. Оказалось, что Хомский не входит в ряды поклонников ИИ.

Работы Хомского в лингвистике повлияли на многих специалистов, изучающих человеческий интеллект. В основе его теорий лежит идея о том, что в нашем мозге существуют четко прописанные и фиксированные правила. Возможно, этим и объясняется его неодобрение современного подхода к ИИ, при котором правила заменяются статистическими корреляциями. Иначе говоря, мы не можем объяснить, почему эти ИИ считаются разумными; они просто таковыми являются.

Сторонники статистических методов в глазах Хомского подобны ученым, которые изучают танцы пчел и моделируют движения этих насекомых, не задаваясь вопросом, почему пчелы делают это именно так. По мнению Хомского, статистические методы дают нам предположение, но не понимание. «Это новое определение успеха. Ничего подобного в истории науки я не встречал», – сказал он.

Питер Норвиг, директор по исследованиям в Google, ответил Хомскому в эссе на своем сайте. Огромное негодование у него вызвал комментарий Хомского о том, что статистический подход имел «ограниченный успех». Как утверждал Норвиг, сейчас статистический подход, наоборот, является доминирующей парадигмой. Которая, кстати, приносит по несколько триллионов долларов в год. В академическом эквиваленте грубого оскорбления он сравнил взгляды Хомского с мистицизмом.

И все же основное разногласие между двумя исследователями было более фундаментальным. Норвиг утверждал, что ученые, подобные Хомскому, которые стремятся создавать более простые и изящные модели для объяснения мира, уже устарели. «Не факт, что природу черного ящика получится описать простой моделью», – говорит он. Норвиг считает, что подход Хомского создает иллюзию понимания, но не имеет ничего общего с реальностью.

То, что началось с разногласия об ИИ, похоже, переросло в спор о природе самого знания.